半导体缺陷检测:从人工目检到AI自动分类的技术演进

核心结论

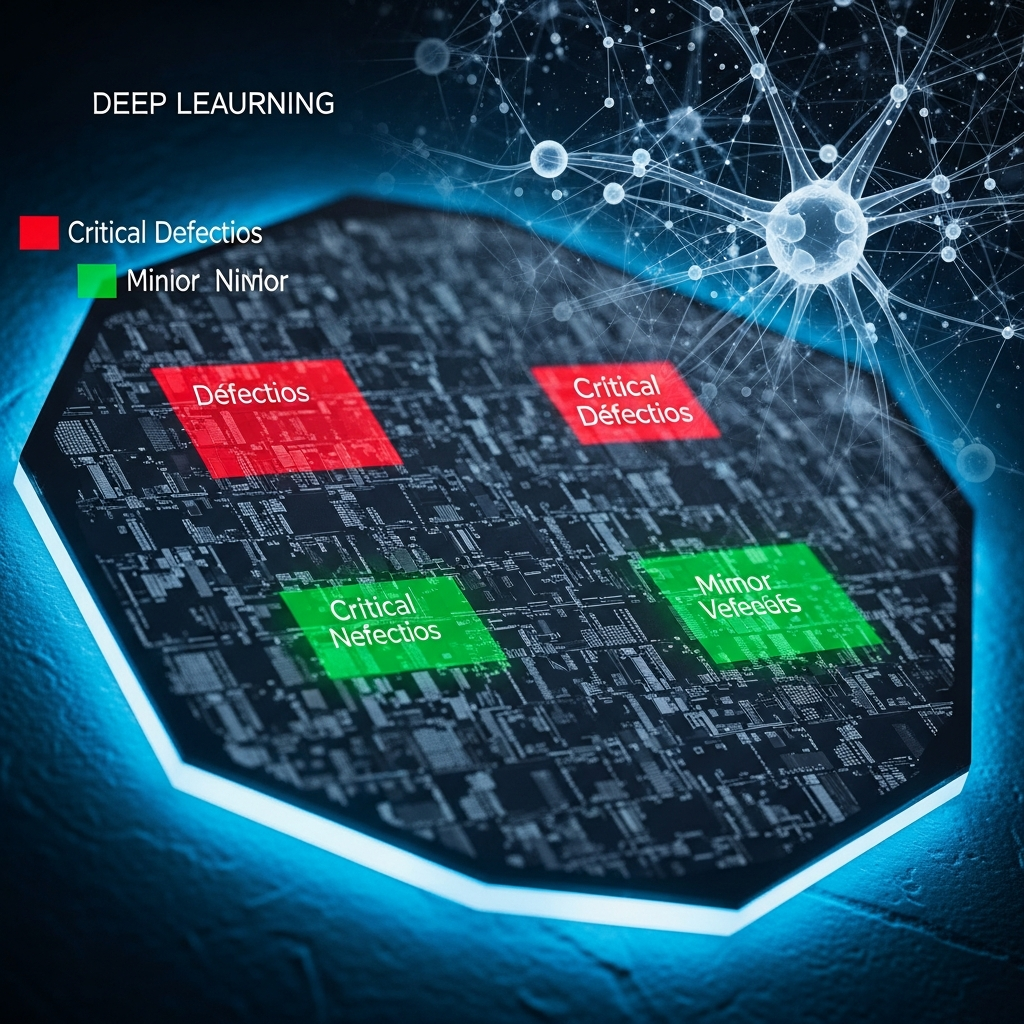

半导体缺陷检测从ADC升级,AI准确率达95%+,远超人工目检70-80%。检测速度提升数倍,能自动关联缺陷根因。

在先进半导体制造中,缺陷检测是良率管理的第一道防线。随着制程节点从28nm推进到5nm乃至3nm,任何一个纳米级缺陷都可能导致整颗芯片报废。7nm节点的致命缺陷密度(D0)要求低于0.1个/cm²,3nm节点进一步收紧至0.05个/cm²以下。

传统的人工目检模式已经无法满足先进制程的需求。一位经验丰富的缺陷审查工程师每天最多能分类2000-3000张缺陷图片,而一座月产能5万片的12英寸晶圆厂,每天产生的缺陷图像可达数十万张。

一、缺陷检测的三大技术路线

1.1 光学检测(AOI / 明场 / 暗场)

光学检测是晶圆厂中部署量最大的在线检测手段。

- 明场检测(Bright-field):适合检测图案化缺陷。代表设备包括KLA 39xx系列和Hitachi IS3000。

- 暗场检测(Dark-field):对微粒污染、划伤等非图案缺陷极为敏感。KLA Surfscan SP7可检测到12nm级别的微粒。

- 核心优势:速度快,单片晶圆检测时间30-120秒,适合100%全检。

1.2 电子束检测(SEM / e-beam)

分辨率可达亚纳米级别,远超光学检测。但速度是致命短板,主要用于抽检。

1.3 在线工艺监控(OES / 传感器融合)

通过监控工艺参数异常来间接预测缺陷发生。真正的实时性,在缺陷产生的瞬间就能发出预警。

二、缺陷分类的核心痛点

2.1 人工分类的双重瓶颈

审查者间一致性通常只有70%-85%。新入职工程师需要6-12个月才能建立足够经验。

2.2 规则引擎维护成本失控

7nm节点缺陷类型可达80-120种,规则库膨胀到数千条后几乎不可维护。

2.3 数据不平衡

常见缺陷占60%-70%,而某些致命缺陷类型只有几十个样本。

三、AI自动缺陷分类(ADC)技术路线

3.1 CNN图像分类

ResNet-50/101在缺陷分类上top-1准确率可达93%-97%。EfficientNet在精度和效率之间取得更好平衡。

3.2 目标检测

YOLO系列速度极快(>100 FPS),mAP@0.5可达85%-92%。Faster R-CNN精度更高但速度约为YOLO的1/3。

3.3 语义分割

基于U-Net或DeepLab的像素级标注,对CD相关缺陷分析尤为重要。

3.4 小样本学习与迁移学习

迁移学习可将小样本类别准确率提升15%-25%。Few-shot Learning在每类仅5-10个样本时可达80%+准确率。

四、部署在哪?——边缘AI是唯一选择

产线对推理延迟的要求不超过100ms。晶圆缺陷图像包含芯片版图信息,属于核心知识产权,不允许离开工厂。

集芯的NeuroBox E5200V正是针对视觉检测场景设计的边缘AI平台。支持ResNet/YOLO/U-Net等主流模型本地推理,端到端延迟控制在50ms以内。部署在检测设备侧,图像数据无需出厂。

五、从检测到控制:构建质量闭环

NeuroBox E5200V负责检测端图像推理,NeuroBox E3200负责控制端数据融合和工艺优化。E5200V的分类结果通过SECS/GEM接口实时传送至E3200,驱动R2R和FDC系统自动调整工艺参数。缺陷发现到工艺响应的周期从数天缩短到分钟级。